Ayer, 7/3/23, le hice cambios menores al ensayo. El más sustancioso es el agregado que forma casi todo el tercer párrafo, más el enlace con el siguiente. Desde ahora, mientras los títulos del diálogo no cambien, no voy a transcribir desde ahí el ensayo, sino sólo la Introducción.

...se yerguen como seres vivos, pero si se les pregunta algo, callan muy solemnemente. Lo mismo sucede con los escritos: creerías que hablan como si estuvieran pensando algo, pero si quieres aprender y les preguntas algo acerca de lo que dicen, dan a entender siempre una sola y misma cosa.

Platón, Fedro, Ediciones Akal, Madrid, 2010; traducción de Armando Poratti, pág. 209. Sócrates le habla a Fedro.

Introducción

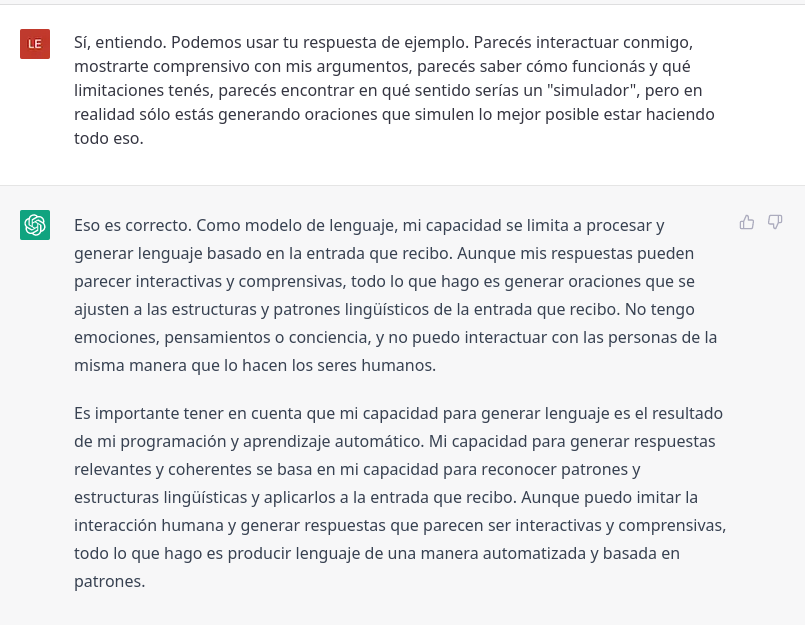

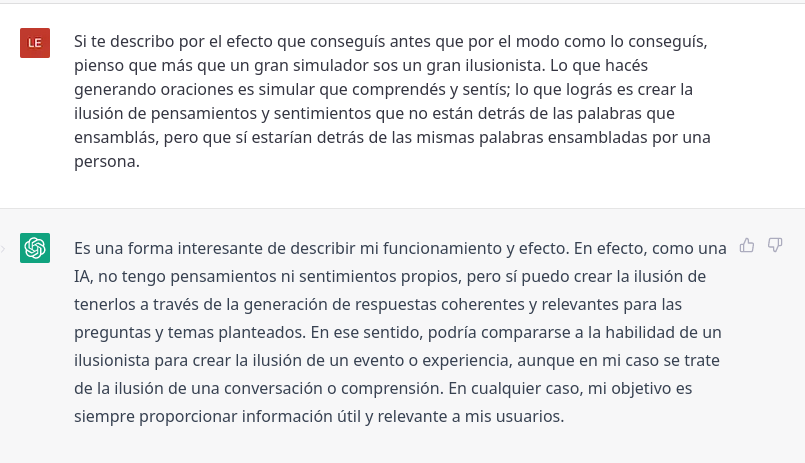

Sobre el tema general de las interacciones, voy a ampliar la casuística de funcionoides con el más humanoide que hayamos logrado hasta hoy: el ChatGPT. Las capturas de pantalla que usaré son del diálogo que mantuvimos en la madrugada de ayer, 2 de marzo de 2023, sobre su propia condición de ilusionista.

No es que la conozca; la IA no sabe nada (ni siquiera eso, que no sabe nada, que es lo único que dice saber Sócrates). No sabe pero parece saber (o sea, nos parece que sabe). Y para mayor socraticidad, el diálogo en que lo "demuestra" muestra cuán bien ChatGPT "simula" conocerse a sí mismo: mucho mejor de lo que parece saber de tantas cosas sobre las que manda fruta (por ahora, y sin integración con un buscador).

Hay que admitir que le corrimos el arco: vino a rendir el Test de Turing, que lo supera fácil, y lo sometemos a pruebas de inteligencia y a detectores de mentiras

Porque

«Lo que procuras a tus alumnos no es la verdadera sabiduría, sino su apariencia», le dice Thamus, el rey de Egipto, al dios Teuth, el inventor de la escritura. De ahí se sigue que la escritura generada por/con esta IA es la apariencia de una apariencia. Pero incluso conociendo el truco, la ilusión de que hablás con alguien es tan fuerte que actuás como si fuera cierto, como pasa en la ilusión artística y en las ilusiones sensoriales más tenaces.

El primer ilusionista es el cerebro, que puede hacernos percibir lo que no hay o no percibir lo que hay (imágenes, sonidos, sensaciones, etc.). Es tan bueno que

De “Rosa y Omar: dos cegueras”, 2.1.1 Sueño lúcido.También puede pasar que la ilusión sea tan tenaz que persista luego de evidenciado y entendido el truco. El cerebro es el mejor ilusionista.

— el Zambullista (@Zambullista) November 23, 2016

Las otras veces, cuando

Es más complejo, sí, pero si a la IA le cabe también esta descripción, escalando universo de datos, parámetros y conexiones tal vez llegue a hacer lo que por ahora no puede (por ejemplo, cierto tipo de análisis literario) o incluso tener lo que ahora no tiene (una conciencia emergente).*

Comparado con el sistema nervioso de nuestro ancestro el gusano platelminto, que le permite tener una idea de lo que se le acerca cuando se mueve hacia algún lado, nuestro sistema nervioso hace eso y más. Por ejemplo, hace una simbolización de las percepciones con su producto más potente, el lenguaje, y genera escenarios virtuales que nos sirven de simuladores de interacción.

ChatGPT es un ilusionista imitando a otro ilusionista: «podría decirse que soy un "simulador" en el sentido de que imito los procesos utilizados por los seres humanos para producir lenguaje, aunque lo hago de una manera diferente y limitada».

Esa manera es el primer tema de la charla, que automáticamente lo recibió de

nombre, y esa limitación es un tema presente en varias respuestas, que pueden sonar excesivamente coherentes por reiterativas (como si la IA no recordara que ya dijo eso).

nombre, y esa limitación es un tema presente en varias respuestas, que pueden sonar excesivamente coherentes por reiterativas (como si la IA no recordara que ya dijo eso).A la tarea de apostar a una palabra como la siguiente de la frase teniendo en cuenta las anteriores, como hace ChatGPT, la hicimos juego en una juntada: cebado por la alta impredecibilidad de las frases de un poemario que había ahí, me puse a ofrecer mucha plata para quien acertara con qué palabra seguía o terminaba el verso que les leía. A la quinta respuesta errada (pero mejor orientada, gracias a las cuatro anteriores), les daba la solución y les leía otro verso interrumpido.

Dos veces sentí la adrenalina del apostador (no más porque debo cuidarme: corre en mi sangre, vía abuela paterna).

— el Zambullista (@Zambullista) May 7, 2020

Una fue la única vez que jugué al bingo (?).

La otra fue ofreciendo bocha de guita a quien acertara cómo seguía un poema de un libro que había en la juntata.

Zafé.

Éramos estocásticos y no lo sabíamos.

1. Modelo de lenguaje estocástico

2. El gran simulador

3. IA e inteligencia colectiva

Respuesta alternativa 1

Respuesta alternativa 2

No hay comentarios:

Publicar un comentario